说到3D,很多人的第一反应可能是酷炫生动的3D电影,以及它为我们带来的欢乐亦或惊险之旅。

但你知道吗?正如3D电影的拍摄是一项“大制作工程”一样,3D深度视觉的形成也是一个庞大的系统性工程,需要人体多系统的介入、协调来完成。

深度感知是在三维空间(3D)和物体距离上感知世界的视觉能力[1]。我们的大脑在判断所看到物体的深度时,往往会使用两种视觉线索:生理学线索和心理学线索。

前者是将真实的物理信息提供给大脑,而后者则提供的是一些视觉幻象。

在我们的大脑作出判断所使用的视觉线索中,生理学线索蕴含着真正的物理深度信息,典型的生理学线索由晶状体聚焦、辐辏、以及双眼视差3个因素构成。

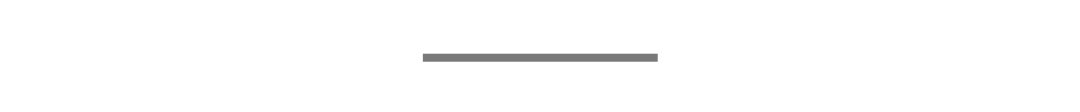

我们的晶状体(lens) 是一个神奇的镜头,随着周围肌肉的伸缩和舒展,这个神奇镜头的焦距可以在一定范围内自由调节。

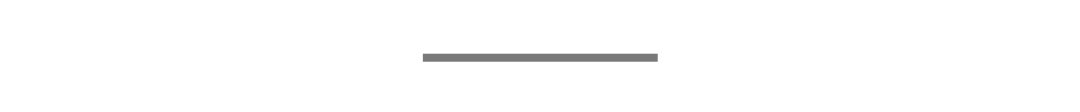

也就是说,正常情况下,当平行光进入人眼时,它会被晶状体自动汇聚到视网膜(retina)上的一个点。由此以来,如图(1)(A&B)所示,我们可以将物理世界中真实的深度信息准确成像至视网膜上。

而晶状体对于平行光的自动汇聚功能,则是通过睫状肌的收缩或松弛改变屈光度来实现的。

如果一个人眼球中睫状肌调节负担过重,就会导致晶状体过度变厚且不能恢复原状、或者眼球的前后径过长,以至于晶状体的屈光能力过强;远处物体的光线通过这个神奇镜头的折射所形成的物像,就会落在视网膜的前方[2]。

如图(1)(C)所示,在这种情况下,这个人看到的就会是一个模糊不清的物像,而这就是近视眼的成因。

除去单眼的晶状体调节功能之外,我们的双眼也能够捕捉真实存在的深度信息。在视觉信息方面,辐辏就是指双眼同时向反方向运动以获得或维持单一的双眼视觉的行为[3]。

当我们在看物体A时,我们其实是在通过双眼视线根据物体A发生的相反方向的变化运动后汇聚到我们视网膜上的一个点,来感知物体A的位置的。

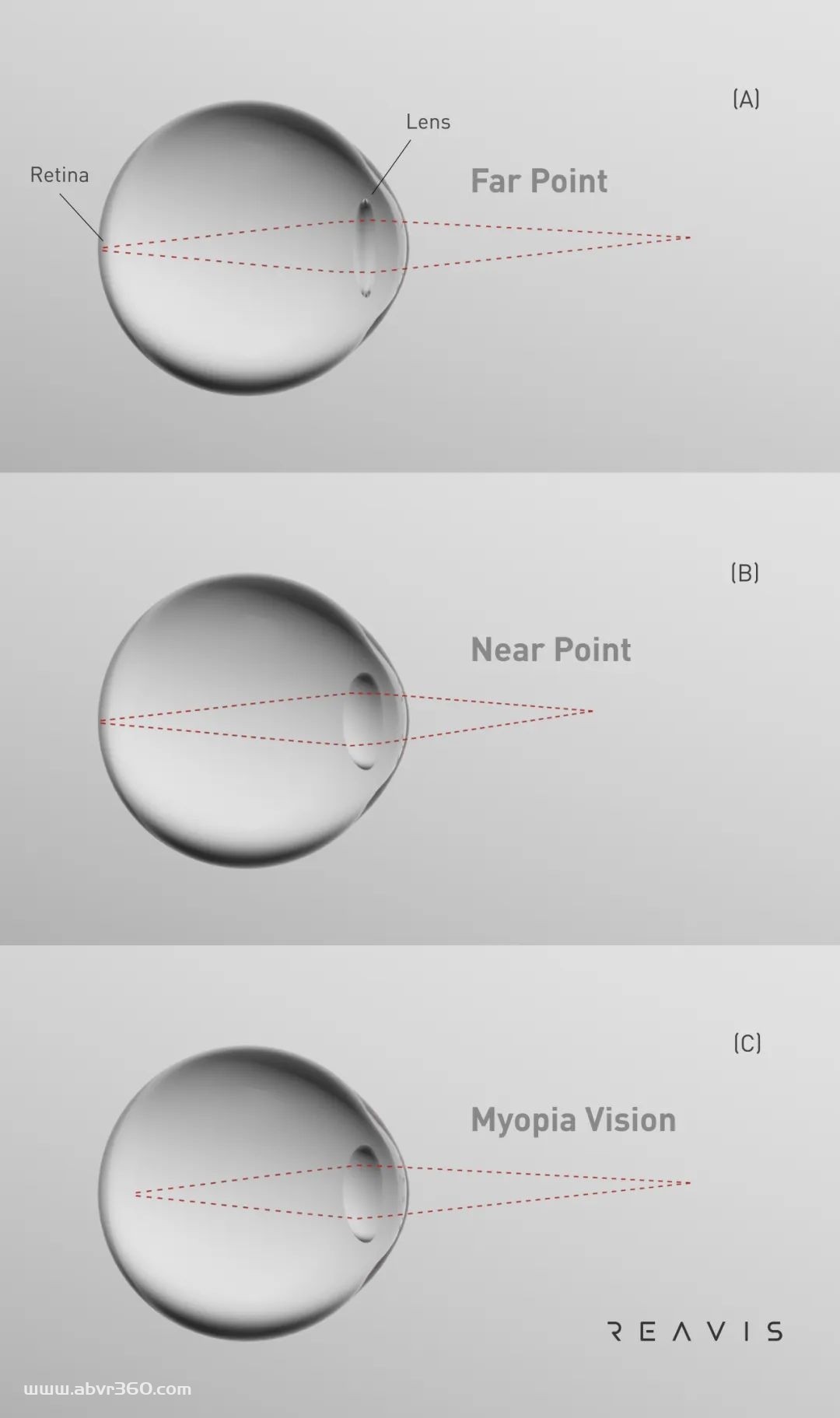

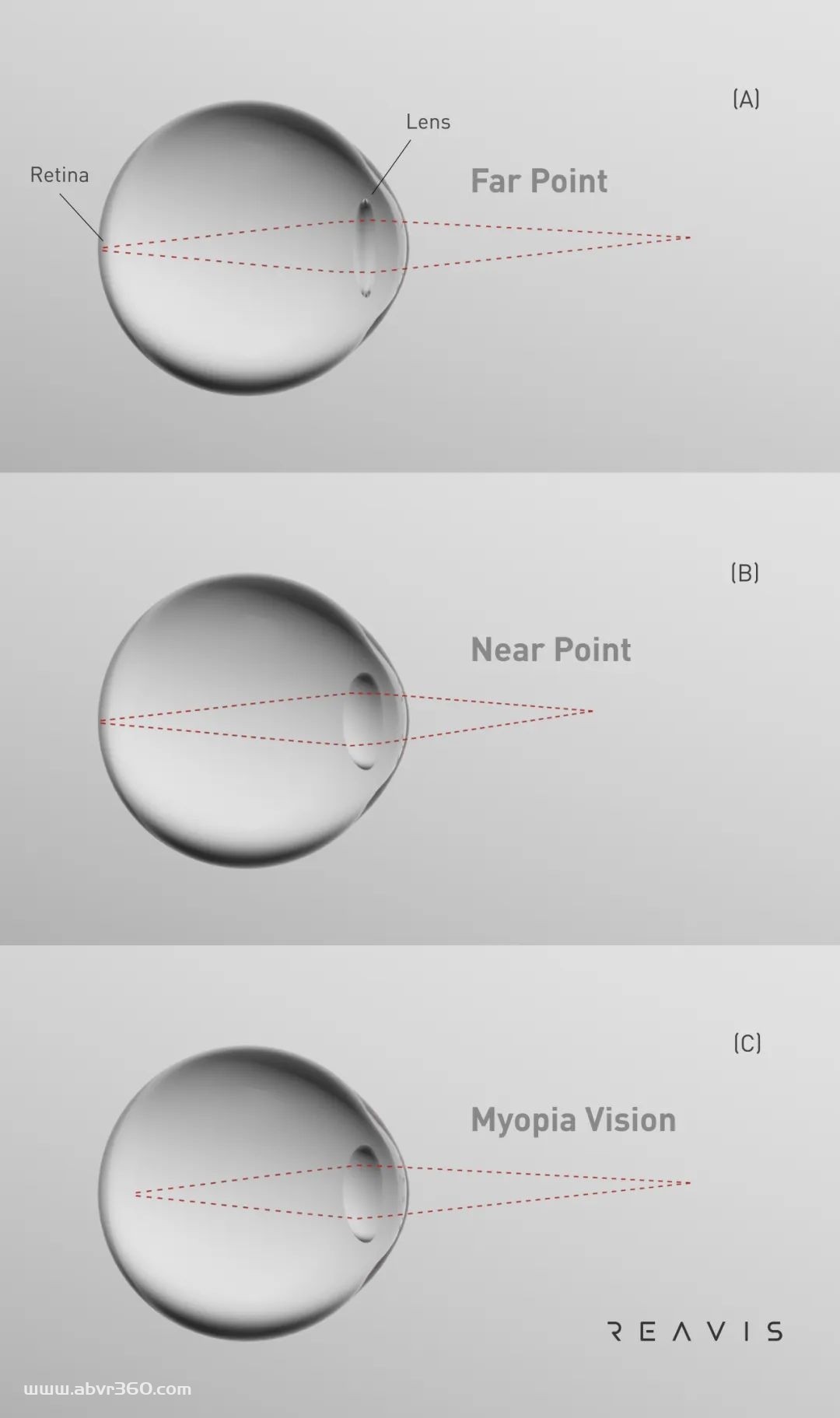

当我们在看远处的物体时,眼睛会彼此转动远离,有效地将同一点固定在无限远,目光也就会随之发散直到平行,这便是一个人在远眺时深邃的、涣散的眼神,如图(2)(C);而当我们看近处的物体时,眼睛会朝着聚合的方向转动,这就叫做“辐辏”[3],夸张一点就会成为“斗鸡眼”,如图(2)(A)和(B)。

图(2). 辐辏的三种不同形态:从左到右依次为“斗鸡眼”、一般辐辏和平行视线

辐辏本质上是一种用于距离和深度感知的双目动眼神经提示,是一种由内在肌肉完成的收敛性眼球运动[4]。每只眼睛外侧肌肉使用转动眼球的力的强弱,为大脑提供了关于物体距离的线索[5]。

如果将手指放在眼睛前方20厘米处,眼球肌肉转动的力需要比手指在50厘米处时更加大,也给大脑信息提供了说明:20厘米的距离的确比50厘米近。

双眼视差 (Binocular Parallax)

值得一提的是,当我们看同一个物体,用上面已经提到的专业术语来说,当我们两眼视轴辐辏在这个物体上时,物体的映像就会落在两眼视网膜的对应点上。

如果我们双眼的视网膜重叠起来,那么它们的视像重合,我们就能够看到单一、清晰的物体。

然而,人的眼距往往在65毫米左右,这就意味着每一个人双眼的视网膜之间会存在着65毫米左右的间距,从而,在观察物体时,我们两眼的视网膜上会出现物像差异,这样的差异就是双眼视差[6]。

双眼视差在深度视觉领域有着非凡的意义。图(3)中的两张有细微差异的图片各自传递出的信息,将在大脑的视觉皮层中被处理,从而让我们获得深度感知,估计到物体的距离。

开头中提到的3D电影,就是充分利用双眼视差的原理实现的:如图(4)所示,电影放映时,两台放映机同步运转,同时画面投放在银幕上,形成左像右像双影。

观众的特制眼镜或幕前辐射状半锥形透镜光栅,使观众左眼只看到从左视角拍摄的画面,右眼只看到从右视角拍摄的画面,最后经过大脑的融合,成为3D视觉影像[7]。

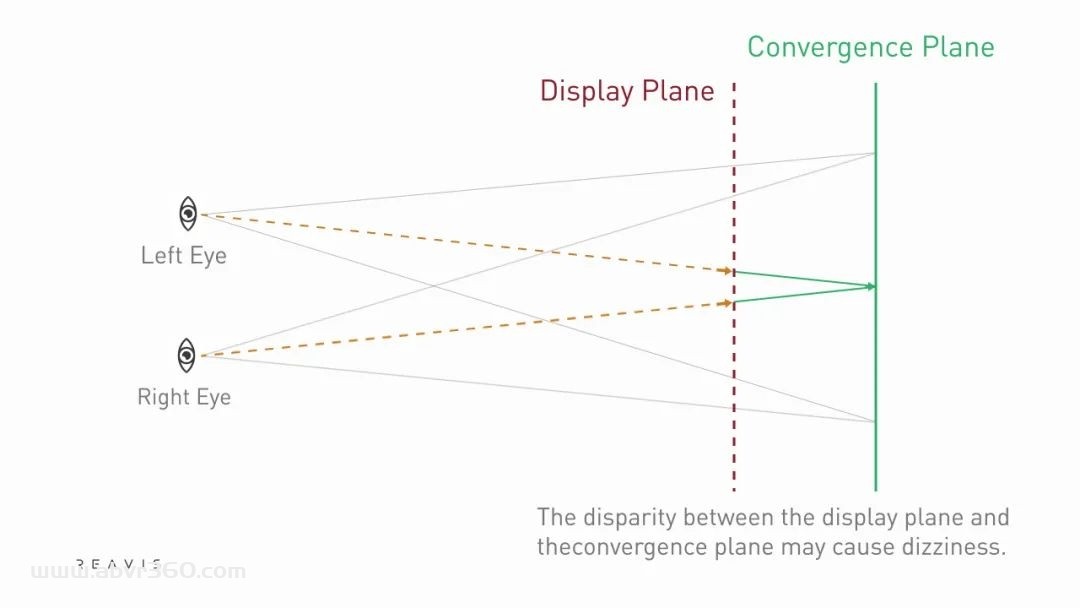

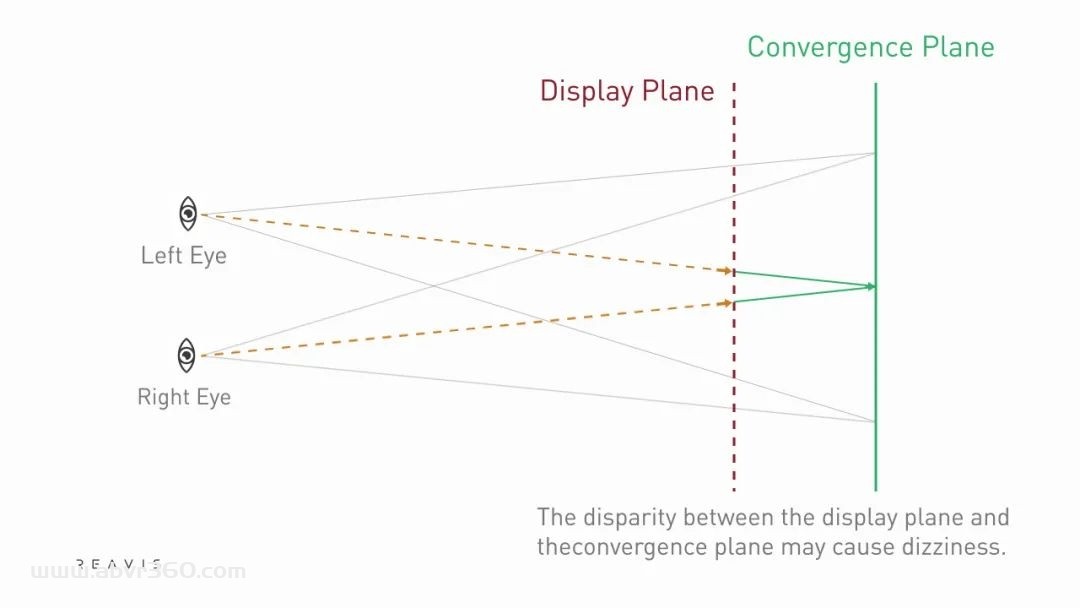

那么,为什么我们看3D电影的时间久了,会有眩晕的感觉呢?开头说过,眼球里的晶状体会自动根据物体的距离聚焦;而在我们观看3D电影时, 晶状体聚焦的平面和双眼辐辏的汇聚平面通常不一致。

3D电影的画面变换非常快,所以人眼需要频繁使用聚焦和辐辏两种功能,使物体的像准确地落在视网膜上。短时间内,我们还能忍受这种需要频繁发生的功能,但一段时间后,就会产生视觉疲劳甚至头晕恶心之感。

以上是生理学线索在3D深度视觉的形成中所起到的作用。在下一期文章里,我们将为大家介绍另一个关键——心理学线索在3D深度视觉这个庞大工程中所做的贡献。

#参考来源:

[1]Howard, Ian. (2012). "Perceiving in Depth. New York: Oxford University Press". ISBN 978-0-199-76414-3.

[2]https://www.nei.nih.gov/learn-about-eye-health/eye-conditions-and-diseases/refractive-errors

[3]Cassin, B. (1990). "Dictionary of Eye Terminology. Solomon S.Gainesville, Fl: Triad Publishing Company". ISBN 978-0-937404-68-3.

[4]Okoshi, Takanori. (2012). "Three-dimensional imaging techniques. Elsevier". p. 387.

[5]Saladin. (2012). "Anatomy and Physiology The Unity of Form and Function, 6th Ed. McGraw-Hill".

[6]Qian, N. (1997). "Binocular Disparity and the Perception of Depth, Neuron". 18, 359–368.

[7]Squires, Scott. (2011). "Effects Corner: 2D to 3D Conversions".

原文始发于微信公众号(艾邦VR产业资讯):AR/VR基础原理——3D深度视觉