眼球追踪技术作为AI/AR眼镜的核心交互方式之一,近年来在硬件小型化、算法优化和能效提升等方面取得了显著进展。得益于感应器体积的进一步缩减和集成度的提升,眼球追踪模组如今能够更轻松地嵌入到轻薄型眼镜中而不影响佩戴舒适性。同时,配合高精度追踪算法的不断演进,眼动数据的识别速度与准确性大幅提升,使眼神操控、视线交互、视线输入等功能变得更加自然流畅。

随着这些关键技术的成熟,眼球追踪正逐步从实验室走向实际应用,成为AI/AR眼镜实现沉浸式、低延迟人机交互体验的关键支撑之一。

一、眼球追踪技术

(1)眼动追踪技术的介绍

眼球追踪(Eye Tracking)是一种通过捕捉和分析眼球运动信息,实时测量视线方向、注视点位置及眼动模式的技术。其核心在于将人眼的生理特征转化为可计算的数据,实现“视线即交互”的智能化控制。

通过利用传感器,如红外摄像头记录眼球/瞳孔位置、瞳孔变化、虹膜角度、视线轨迹、角膜反射点,通过算法解析视线变化从而得到视觉注意力的分布。其技术的实现需要硬件与软件的结合。

(2)眼动追踪技术分类

● 传统瞳孔角膜反射法——使用IR图像传感器,通过瞳孔中心数据和近红外光源在角膜上反射的图像进行眼球追踪;

● 基于MEMS的扫描方案——利用MEMS微镜对眼睛进行光线扫描,再通过接受器分析光线强度变化来进行眼球追踪;

● 基于DVS的瞳孔角膜反射法——与基于IR的瞳孔角膜反射法的区别在于,其IR图像传感器,替换为DVS图像传感器;

● 直接图像处理方案——通过图像传感器获取眼睛图像,再利用如瞳孔在图像中的各方向直径变化等特征数据进行眼球追踪;

其中应用最普遍的是传统角膜反射法,其原理是将一些低功率主动近红外照射到人眼中,这种人眼无法看到的光会在角膜上产生反射,然后通过传感阵列捕捉近红外图像,经过近红外信号处理后获得眼部特征并识别瞳孔位置,估算出人眼的注释方向以及注视位置,具备精度高、非接触、干扰小、无创等优点。

目前眼球追踪技术正在从实验室走向大众的生活,为医疗、交通、消费电子等领域带来颠覆性的改革。将眼球追踪技术与AI/AR眼镜相结合,将会给智能终端带来更多的精彩应用,包括人机交互、健康监测、身份认证、商业分析、智能驾驶监督、具身智能、表情追踪、虚实结合等应用场景。

七鑫易维眼球追踪技术

二、应用场景

(1)人机交互

基于图片的交互模式效率低下,在缺乏准确的指令下,AI只会把图片上所有的信息进行分析,一一列举,用户体验感较差。而眼动追踪模式对视线扫描目标进行控制,聚焦重点区域实现高效互动,且降低延迟及功耗,提高续航。利用AI/AR智能眼镜搭载的前置摄像头进行多模态交互,利用眼球追踪的指向性,可以基于拍摄的画面进行提问或翻译,并纠正画面拍摄范围,提高智能设备的交互效率和准确性。

实际应用中例如识别游戏玩家的视线焦点,提升局部注视区域的画面高清度,可以降低GPU的载荷,提升游戏流畅度;并触发视角切换和互动,代替传统手柄操作,增强沉浸感。通过视线移动控制上下文翻页,进行页面选择,菜单控制。通过虹膜识别以及眼球运动轨迹进行身份验证,完成商品支付等。

(2)健康检测

眼球运动与大脑神经功能具有深度关联性,眼球运动由前额叶皮层、顶叶、基底节等区域协同控制,若发生神经退行性疾病(如阿尔茨海默病、帕金森病)和精神疾病(如精神分裂症)时,上述脑区将容易受损,进而导致眼动模式异常。眼动追踪技术能够进行视觉健康检测:监督用户用眼时长、距离、疲劳度等,进行近视、弱视、斜视的预防检测。认知健康检测:检测认知障碍,例如儿童多动症、自闭症;老年人认知障碍、老年痴呆;成年人抑郁症、精神分裂等。

具有眼动追踪技术的眼健康筛查EyeSwift系统

(3)商业分析

通过追踪消费者及使用者对商品或广告注视时长、视线路径,识别高吸引力元素,获取用户行为数据,并进行商业分析、广告分析、用户体验分析、消费者心理分析,帮助企业和研究者获得对人类自身行为更深入的洞察,以及优化广告营销策略。

七鑫易维自研商业分析眼动平台aSee Studio 2025新版UI界面

(4)智能驾驶监督

追踪驾驶员的瞳孔变化、眨眼频率,分析其注意力分散、疲劳情况,实现对驾驶过程的监控,对驾驶员的疲劳驾驶行为进行预警,提高驾驶安全性。通过眼动热力图分析驾驶员对仪表盘、中控屏的关注优先级,调整关键信息(如车速、导航提示)的位置与大小。当驾驶员注视导航屏时,自动放大复杂路口信息;视线移回道路后恢复简洁界面。

(5)具身智能

将人类的眼动数据作为机器人训练数据,让机器人像人类一样感知世界、理解世界,并与人类进行交流互动。人类视觉系统通过眼动快速筛选关键信息,具身智能系统借助眼球追踪数据,可训练机器人学习动态优先级决策能力。例如工业机器人通过分析工人维修设备时的眼动热区,训练机器人自动定位异常部件,提升维修效率。

利用眼动追踪技术获取人类行为数据之后,从而更好的构建“类人感知”的认知框架,通过注意力建模训练机器人有限决策的能力,眼动数据解释了意图与动作之间的关联性,帮助机器人学习非语言交互的规则。

(6)表情追踪

眼动追踪结合计算机视觉与深度学习算法,能够实现对人类情绪状态的实时捕捉与解析。未来社交场景以及远程会议等场景可以基于眼动数据生成虚拟数字人的动态表情,并根据用户注视热点动态调整数字人的表情反馈策略,提供个性化交互。

羽迹科技数字人

7月4日,在艾邦第六届AR产业发展论坛上,七鑫易维 XR副总裁 路伟成也为大家讲解了眼球追踪在AI/AR眼镜中的部分应用场景。

眼动追踪技术已成为VR/AR设备的重要组成部分。苹果Vision Pro、三星Moohan头显、Meta Quest Pro、PICO 4 Pro、HTC Vive Pro 2、小派科技Pimax Crystal等VR头显设备以及AR眼镜都使用了眼动追踪技术。

三、部分近期发布支持眼动追踪的AR/VR设备

1、歌尔高精度眼动追踪AR智能眼镜

2025年7月17日,歌尔在首届创新大会上推出高精度眼动追踪AR智能眼镜,算法响应延迟小于3ms,采用超薄碳纤维框架和超轻钛合金铰链,总重仅有36克,是行业内最轻的AR眼镜;双相机多光源方案+先进眼动算法,实现全眼域眼动追踪,平均准确度可达0.5°。

图片来源:歌尔

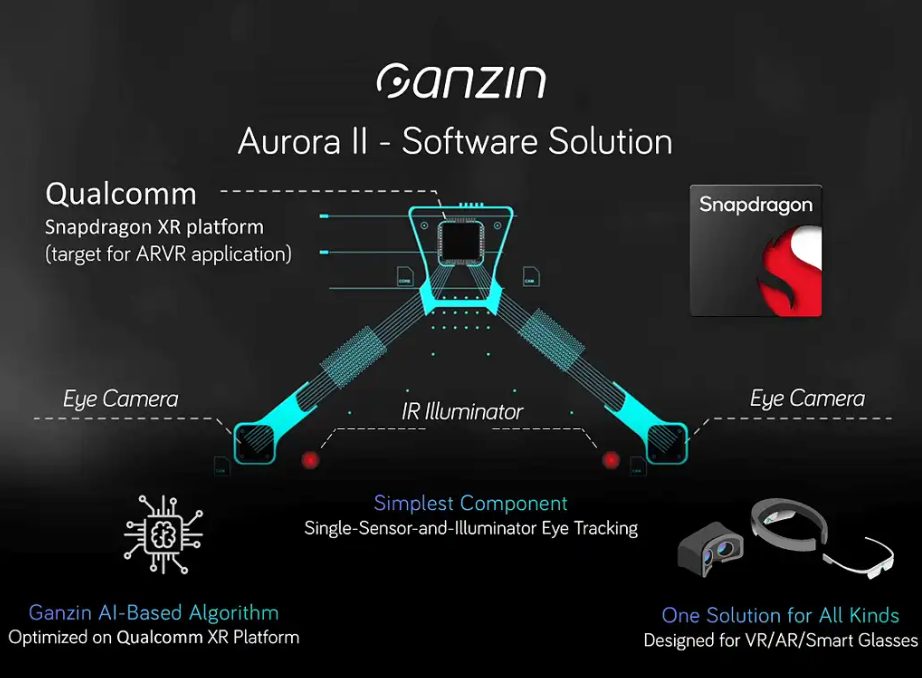

2、Ganzin见臻科技支持眼动追踪的SOL眼镜

Ganzin见臻科技推出其用于高精度3D空间注视点追踪的Gaze2AI,基于该公司的AURORAIIS硬件构建,并由其Aurora-II眼动追踪算法驱动。Ganzin的眼动追踪眼镜SOL眼镜专为各种与眼部数据相关的研究应用而设计,该眼镜包括:两个用于精确注视点追踪的内向红外摄像头和照明器以及一个用于捕捉视觉情境的 1.3K x 1.2K 分辨率的朝外彩色摄像头。

Ganzin Sol穿戴式眼动仪

Ganzin Aurora Ⅱ软件解决方案

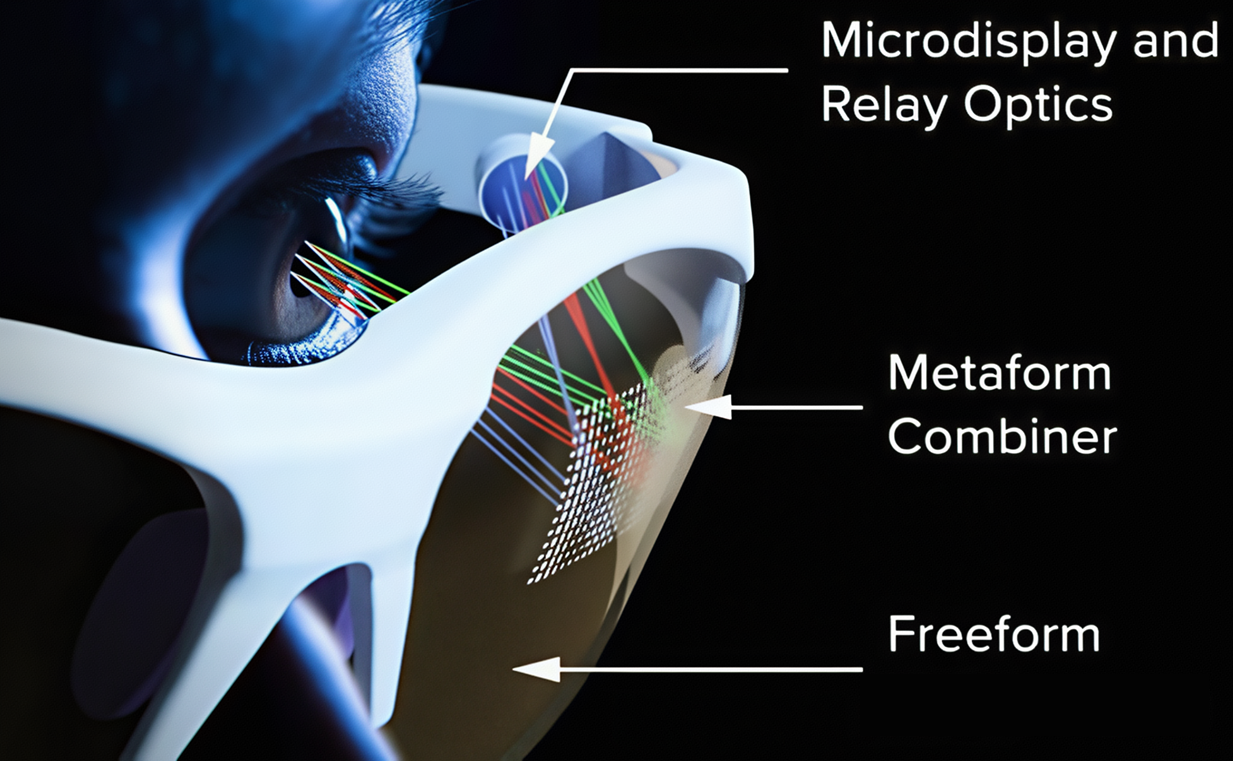

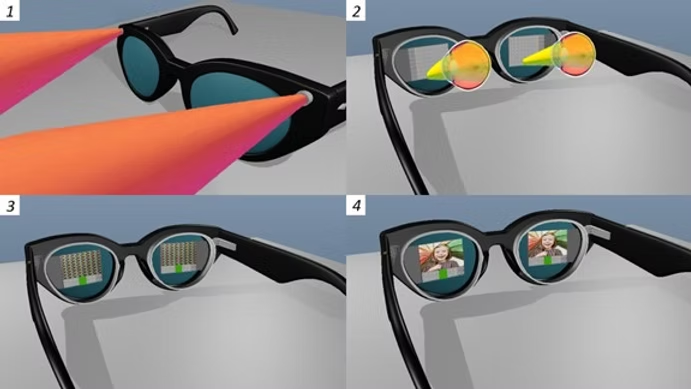

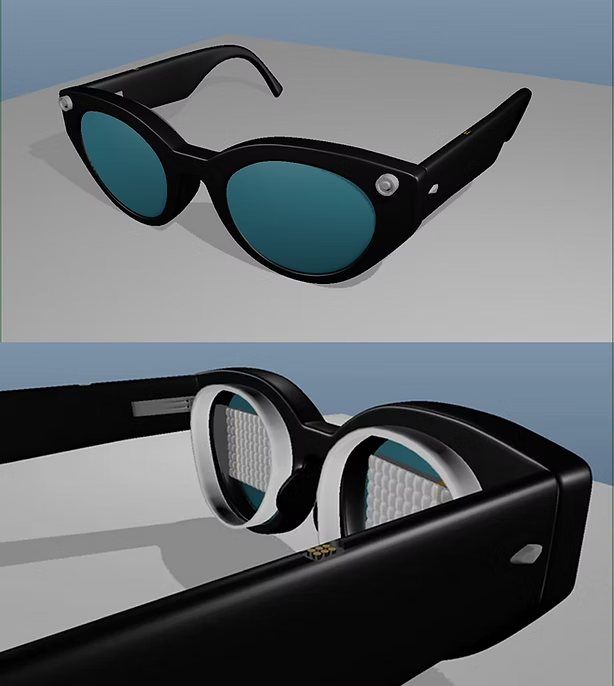

3、Solidd低视力辅助眼镜SolidddVision

Solidd的低视力辅助眼镜SolidddVision采用独特的专有镜头阵列,将多个单独的图像投射到视网膜未受损的区域。这使得大脑自然地构建立体视觉和具有良好敏锐度的全视野图像,弥补受损的视力缺陷。SolidddVision的采集以及视觉传输主要分为四步:两个相机捕捉真实世界画面;两个向内的相机捕捉眼动数据;基于眼动数据处理视频源,并将100多个不同的视图呈现在显示屏幕上;用户根据看到的屏幕画面还原为3D、清晰聚焦的画面。

SolidddVision眼镜视觉采集原理示意图

4、小派科技Crystal Super头显

小派科技Crystal Super具有可更换光学系统,重量约815克,分辨率高达 3840×3840×2,PPD为57、刷新率有72Hz、90Hz可选,视野达120°(水平)。屏幕采用 QLED+MiniLED(局部调光)技术,支持眼动追踪、IPD自动调整、注视点渲染。

5、秋果计划Wigain Omnision眼镜

秋果计划Wigain Omnision眼镜采用的是LCoS+二维扩瞳阵列光波导方案,分辨率达到了1080P,FoV 50°,刷新率60Hz,透光率大于85%,最高入眼亮度可达900尼特。此外,眼镜还支持眼动追踪功能,眼镜前方有一枚1600万像素的RGB摄像头,以及两颗用于SLAM空间定位的摄像头。

6、玩出梦想MR一体机

玩出梦想MR搭载了高通第二代骁龙XR2+芯片、双目8K Micro-OLED屏幕和双3200万像素高清摄像机,视觉感受十分逼真,VST仅有14毫秒的延迟。交互方式丰富,设备支持眼动追踪功能,用于渲染优化、身份识别、视线追踪等领域。

7、大朋VR新品头显DPVR P2 Vision

大朋VR与眼动追踪技术方案商Ganzin联合开发头显新品DPVR P2 Vision,眼动追踪技术由见臻科技的Aurora IIS NPU解决方案支持,P2 Vision结合了单传感器与红外照明技术,确保高精度追踪,能够实现实时响应,提供流畅且直观的用户体验。产品将聚焦于培训、医疗等专业领域。

资料来源:七星易维、歌尔、见臻科技等公司官网以及网络资料